ปัจจุบัน เทคโนโลยีปัญญาประดิษฐ์ (Artificial Intelligence: AI) ได้รับการพัฒนาเพิ่มขึ้นจนกระทั่งมีศักยภาพเพิ่มขึ้นอย่างต่อเนื่อง และได้เข้ามามีอิทธิพลต่อกิจกรรมของมนุษย์ ไม่ว่าจะเป็นกิจกรรมทางเศรษฐกิจและสังคม และนำมาซึ่งผลกระทบเชื่อมโยงไปยังคนกลุ่มต่างๆ มากขึ้น ซึ่งเมื่อพิจารณาทั้งระบบนิเวศของปัญญาประดิษฐ์ก็ยังพบผู้ที่เข้ามาเกี่ยวข้องจำนวนมาก ตั้งแต่กลุ่มผู้พัฒนาเทคโนโลยีปัญญาประดิษฐ์ กลุ่มผู้ใช้งานปัญญาประดิษฐ์ กลุ่มผู้ให้บริการที่เกี่ยวข้องกับ รวมทั้งกลุ่มผู้กำกับดูแลปัญญาประดิษฐ์ ซึ่งผู้ที่เกี่ยวข้องทั้งหมดล้วนเข้ามาอยู่ภายใต้ระบบนิเวศของปัญญาประดิษฐ์ และมีส่วนเกี่ยวข้องกับปัญญาประดิษฐ์ไม่ทางตรงก็ทางอ้อม (ธนาคารแห่งประเทศไทย อ้างถึงใน กระทรวงการอุดมศึกษา วิทยาศาสตร์ วิจัย และนวัตกรรม และกระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม, 2565) อย่างไรก็ตาม แม้ว่าความก้าวหน้าของเทคโนโลยีปัญญาประดิษฐ์จะก่อให้เกิดประโยชน์ต่อสังคมอย่างกว้างขวาง แต่ก็ปฏิเสธไม่ได้ว่าเทคโนโลยีดังกล่าวก็กำลังเป็นภัยคุกคามที่น่ากลัวแก่สังคมของมนุษย์ เพราะเมื่อเทคโนโลยีดังกล่าวเข้าไปเกี่ยวข้องกับคนกลุ่มต่างๆ ที่มีความต้องการและบรรทัดฐานที่แตกต่างกัน การใช้ปัญญาประดิษฐ์เพื่อประโยชน์ของคนกลุ่มหนึ่งอาจนำมาซึ่งการสร้างผลกระทบทางลบต่อคนอีกกลุ่มหนึ่งได้ ซึ่งปัจจัยที่ทำให้เกิดปัญหาดังกล่าวอาจเนื่องมาจากผู้ที่เกี่ยวข้องกับกระบวนการพัฒนาปัญญาประดิษฐ์มักจะเลือกใช้ข้อมูลหรือแบบจำลองไปในทางที่จะสนองความต้องการของตัวเองหรือพวกพ้อง (แม้ว่าบางครั้งอาจทำไปโดยไม่รู้ตัวก็ตาม) ซึ่งนับว่าเป็นเรื่องปกติของมนุษย์แต่ละคน ดังนั้น การพัฒนาปัญญาประดิษฐ์ของคนบางกลุ่มจึงอาจนำมาซึ่งความขัดแย้งกับเป้าหมายของสังคมส่วนร่วม เช่น หากปัญญาประดิษฐ์ถูกพัฒนาโดยบุคคลเพศชายก็อาจไม่สามารถนำเสนอผลลัพธ์ที่ดีแก่บุคคลเพศหญิง หรือหากปัญญาประดิษฐ์ถูกพัฒนาขึ้นจากกลุ่มคนผิวขาวก็อาจสร้างผลกระทบทางลบต่อกลุ่มคนผิวสี เป็นต้น

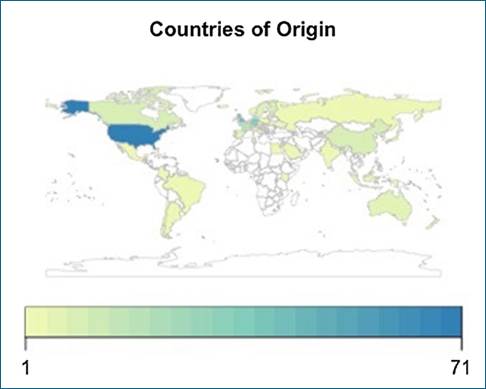

จากปัญหาดังกล่าว ทำให้ภาครัฐในหลายๆ ประเทศให้ความสำคัญกับการพัฒนาแนวทาง นโยบาย กฎหมาย รวมทั้งกฎระเบียบต่างๆ เพื่อกำกับดูแลปัญญาประดิษฐ์โดยยึดหลักจริยธรรมมากขึ้น ตั้งแต่กระบวนการพัฒนาปัญญาประดิษฐ์ การนำปัญญาประดิษฐ์ไปปรับใช้ ตลอดจนการแก้ปัญหาหรือการเยียวยาผู้ที่ได้รับผลกระทบทางลบจากอคติของปัญญาประดิษฐ์ อีกทั้งผู้ที่เกี่ยวข้องในวงการวิชาการก็ยังมีการศึกษาวิจัยที่เกี่ยวข้องกับแนวทางจริยธรรมปัญญาประดิษฐ์อย่างต่อเนื่อง ทำให้มีงานวิจัยจำนวนมากที่กล่าวถึงประเด็นเหล่านี้ แต่อย่างไรก็ตาม การนำแนวทางการกำกับดูแลปัญญาประดิษฐ์บนพื้นฐานของจริยธรรมที่ได้รับการพัฒนาขึ้นตลอดช่วงเวลาที่ผ่านมามาปรับใช้ในสังคมก็ยังประสบปัญหา ไม่สามารถนำมาบังคับใช้ให้เกิดประสิทธิผลมากนัก ส่วนหนึ่งเนื่องจากแนวทางต่างๆ ได้ถูกพัฒนาขึ้นภายใต้บริบทและมุมมองของคนบางกลุ่มเท่านั้น ทำให้การนำไปใช้ในบริบทที่แตกต่างกันไม่ประสบความสำเร็จมากเท่าที่ควรและอาจก่อให้เกิดความขัดแย้งตามมา จะเห็นได้จากงานวิจัยของ Cathy Roche et al (2022) ที่ศึกษาพบว่าอิทธิพลในการออกแบบแนวทางการพัฒนาปัญญาประดิษฐ์ตลอดช่วงที่ผ่านมายังคงกระจุกตัวอยู่ในกลุ่มประเทศพัฒนาแล้ว โดยประเทศที่มีอิทธิพลต่อการพัฒนาแนวทางจริยธรรมมักจะเป็นกลุ่มประเทศพัฒนาแล้วทางตอนเหนือของโลก ในขณะที่ประเทศกำลังพัฒนากลุ่มที่เรียกว่า Global South มักจะไม่ได้เข้าไปมีส่วนรวมในการออกแบบแนวทางจริยธรรมปัญญาประดิษฐ์ ซึ่งงานศึกษาดังกล่าวได้ประมวลข้อมูลออกมาดังภาพที่ 1 ซึ่งจากภาพจะเห็นว่า แถบสีน้ำเงินเข้มซึ่งเป็นพื้นที่ที่มีผู้เข้ามามีส่วนเกี่ยวข้องกับการออกแบบแนวทางต่างๆ จะกระจุกตัวอยู่ทางตอนเหนือของโลก โดยเฉพาะในแถบอเมริกาเหนือ และยุโรป

ภาพที่ 1 บทบาทของแต่ละภูมิภาคของโลก

ที่มีต่อการมีส่วนร่วมในการออกแบบแนวทางจริยธรรมปัญญาประดิษฐ์

ที่มา: Cathy Roche et al (2022)

ดังนั้น งานวิจัยนี้จึงมุ่งเน้นการศึกษาวิจัยเพื่อออกแบบแนวทางในการพัฒนาระบบการกำกับดูแลปัญญาประดิษฐ์บนพื้นฐานของจริยธรรมที่สามารถนำไปปรับใช้ได้กับคนทุกกลุ่มที่มีบรรทัดฐานทางวัฒนธรรมที่แตกต่างกัน และในขณะเดียวกันก็เปิดโอกาสให้ผู้ที่มีศักยภาพในการพัฒนาตนเองสู่การเป็นนักวิจัยในอนาคตจากสาขาต่างๆ ได้เข้ามาร่วมศึกษาวิจัยเพื่อพัฒนาศักยภาพในการคิดวิเคราะห์ในประเด็นที่เกี่ยวข้องกับปัญญาประดิษฐ์บนพื้นฐานของจริยธรรมที่สอดรับกับบริบทของคนกลุ่มต่างๆ ในสังคมมากขึ้น ซึ่งการสร้างความร่วมมือในการต่อยอดและพัฒนาองค์ความรู้ดังกล่าวคาดว่าจะมีส่วนช่วยในการปิดช่องว่างระหว่างแนวคิดเชิงทฤษฎีและความเป็นไปได้ในทางปฏิบัติของการนำแนวทางจริยธรรมปัญญาประดิษฐ์ไปปรับใช้จริงในบริบทที่แตกต่างกัน อีกทั้งยังมีส่วนช่วยในการพัฒนาแนวนโยบายภาครัฐที่จะสนับสนุนให้การพัฒนาและนำเทคโนโลยีปัญญาประดิษฐ์มาปรับใช้ในสังคมก่อให้เกิดประโยชน์สูงสุดต่อส่วนรวมมากขึ้น

2. วัตถุประสงค์

(1) เพื่อพัฒนาองค์ความรู้และเสนอแนะแนวทางใหม่ในการคิดเกี่ยวกับจริยศาสตร์ เรียกว่า “จริยศาสตร์จากพื้นดิน” (Ethics from the ground up) ซึ่งมุ่งไปที่การนำเสนอการให้เหตุผลสนับสนุนที่ปกป้องได้ดียิ่งขึ้นเกี่ยวกับว่า ระบบจริยธรรมของปัญญาประดิษฐ์จะมีบทบาทในเชิงปฏิบัติมากขึ้นได้อย่างไร

(2) เพื่อสร้างรากฐานที่มั่นคงของข้อเสนอแนะเชิงนโยบายเกี่ยวกับจริยธรรม กฎหมาย และกฎระเบียบต่างๆ ที่เกี่ยวข้องกับปัญญาประดิษฐ์

(3) เพื่อสร้างและบำรุงรักษาเครือข่ายของนักวิชาการและนิสิตนักศึกษาในสาขากว้างๆ เกี่ยวกับการศึกษามิติทางปรัชญา สังคม และวัฒนธรรมของปัญญาประดิษฐ์โดยรวม

(4) เพื่อฝึกฝนนิสิตนักศึกษาระดับปริญญาโทและเอก รวมไปถึงนักวิจัยหลังปริญญาเอกในสาขาเหล่านี้

3. ทบทวนวรรณกรรมที่เกี่ยวข้อง

การทบทวนวรรณกรรมภายใต้งานวิจัยนี้ประกอบด้วยการทบทวนแนวคิดที่เกี่ยวข้องกับจริยธรรมปัญญาประดิษฐ์ที่ได้รับการพัฒนาขึ้นจากนักวิชาการในหลายๆ ประเทศ ในขณะเดียวกันก็จะทบทวนงานวิจัยที่เกี่ยวข้องกับการวิเคราะห์และวิพากษ์แนวทางการพัฒนาระบบการกำกับดูแลปัญญาประดิษฐ์บนพื้นฐานของจริยธรรมที่มีความเกี่ยวข้องกับความแตกต่างทางวัฒนธรรมและบรรทัดฐานทางสังคม เพื่อให้ทราบว่าที่ผ่านมา งานวิจัยที่มีอยู่ในพื้นที่ต่างๆ ได้พัฒนาขึ้นอย่างไร และนำไปสู่ทิศทางการเปลี่ยนแปลงในอนาคตอย่างไร

แนวคิดหลักของงานวิจัยนี้คือแนวคิดเกี่ยวกับจริยธรรมปัญญาประดิษฐ์ ซึ่งเป็นการนำแนวคิดด้านจริยธรรมมาประยุกต์ใช้ในการออกแบบปัญญาประดิษฐ์เพื่อให้ปัญญาประดิษฐ์ถูกพัฒนาไปในทางที่จะไม่ก่อให้เกิดผลกระทบทางลบต่อคนในสังคมในรูปแบบต่างๆ ซึ่งที่ผ่านมา การที่ปัญญาประดิษฐ์มีการนำมาปรับใช้ในวงกว้างมากขึ้นจึงทำให้ประเด็นด้านจริยธรรมปัญญาประดิษฐ์ถูกนำมากล่าวถึงอย่างแพร่หลายมากขึ้น อย่างไรก็ตาม การที่จะทำความเข้าใจเกี่ยวกับจริยธรรมปัญญาประดิษฐ์ก็ควรหันมาทำความเข้าใจกับคำว่าจริยธรรมก่อน

เมื่อพิจารณาในระดับพื้นฐานที่สุด อาจกล่าวได้ว่า จริยธรรมเป็นคำที่นำมาใช้ตัดสินว่าอะไรดีหรือเลว หรืออะไรถูกหรือผิด แต่คำว่าจริยธรรมก็มีความซับซ้อน บางครั้งก็ไม่อาจตัดสินอะไรได้อย่างชัดเจนว่ามันคือสิ่งที่ถูกหรือผิดเมื่อมันถูกนำไปใช้ในบริบทที่แตกต่างกัน ซึ่งที่ผ่านมา แนวคิดด้านจริยธรรมเป็นแนวคิดที่พยายามจะหาคำตอบสำหรับคำถามที่ว่า สิ่งใดเป็นเหตุที่ทำให้เกิดการกระทำที่มีจริยธรรมมากขึ้นหรือแย่ลง ซึ่งแนวคิดด้านจริยธรรมที่ได้รับความนิยมนำมาปรับใช้ในการคิดอย่างแพร่หลาย ประกอบด้วย Consequentialism และ Deontology ซึ่งได้เริ่มต้นพัฒนาขึ้นตั้งแต่ศตวรรษที่ 18 โดยในส่วนของ Consequentialism เป็นทฤษฎีทางจริยธรรมที่ให้ความสำคัญกับผลลัพธ์หรือผลลัพธ์ที่เกิดขึ้นจากการกระทำ โดยในการพิจารณาความถูกต้องหรือความผิดของการกระทำจะถูกตัดสินโดยดูจากผลที่เกิดขึ้น หรือกล่าวอีกนัยหนึ่งก็คือ เป็นทฤษฎีที่มองอรรถประโยชน์ของมนุษย์เป็นหลัก (Utilitarianism) ซึ่งนักคิดที่ได้รับอิทธิพลจากแนวคิดดังกล่าวได้แก่ Jeremy Bentham (1789) และ John Stuart Mill (1861) ที่นำแนวคิดดังกล่าวมาพัฒนาระบบการตัดสินใจเกี่ยวกับว่าสิ่งใดถูกหรือผิด ซึ่งสิ่งใดก็ตามที่ทำให้อรรถประโยชน์สุทธิของมนุษย์สูงสุด (ความพึงพอใจลบความไม่พึงพอใจ) ก็จะถูกตัดสินใจว่าเป็นการกระทำบนพื้นฐานของจริยธรรม ในขณะที่แนวคิด Deontology จะเป็นทฤษฎีที่ให้ความสำคัญกับความถูกต้องของการกระทำโดยไม่พิจารณาผลลัพธ์ โดยมีการกำหนดมีค่านิยมหรือหลักที่ถูกต้องไว้ล่วงหน้าให้ทุกคนต้องปฏิบัติตาม และหากใครไม่ปฏิบัติตามก็จะนับว่าไร้จริยธรรม ซึ่งแนวคิดดังกล่าวได้มีอิทธิพลต่อนักคิดหลายคน เช่น Immanuel Kant (1788, 1797) ซึ่งเป็นผู้พัฒนาแนวคิด Categorical imperative ที่มักถูกนำไปกล่าวถึงในแง่มุมของการออกกฎหมาย ซึ่งแนวคิดนี้ไม่เปิดโอกาสให้คนในสังคมได้พิจารณาโดยใช้เหตุและผลแต่ต้องปฏิบัติตามสิ่งที่เป็นกฎเกณฑ์เท่านั้น ซึ่งที่ผ่านมา ทั้งสองแนวคิดข้างต้นได้เป็นแนวคิดหลักในการนำไปประยุกต์ใช้กับการตัดสินด้านจริยธรรมของปัญญาประดิษฐ์ และในยุคต่อๆ มา เมื่อสังคมมีการเปลี่ยนแปลงไปในทางที่มีการนำเทคโนโลยีสารสนเทศมาใช้มากขึ้นก็ยังมีแนวคิดด้านจริยธรรมอื่นๆ ที่มีการนำมาปรับใช้กับการออกแบบจริยธรรมปัญญาประดิษฐ์ เช่น แนวคิด Feminist ethics of care แนวคิด Computer ethics แนวคิด Information ethics และแนวคิด Technology ethics นอกจากนี้ ในระยะต่อมาก็มีนักคิดที่พยายามนำแนวคิดในอดีตมาพัฒนาในบริบทของความก้าวหน้าทางเทคโนโลยี โดย Terry Bynum (2006) ได้พัฒนาแนวคิดด้านจริยธรรมที่เรียกว่า Flourishing ethics ซึ่งเป็นหลักการที่ให้ความสำคัญกับความเป็นอยู่ที่ดีของมนุษย์ และมองว่ามนุษย์เป็นสัตว์สังคมและสามารถพัฒนาตนเองได้เมื่ออยู่ในสังคม แนวคิดนี้มองว่ามนุษย์มีจุดแข็งและทักษะติดตัวมาตั้งแต่เกิด ซึ่งการพัฒนาไปสู่เป้าหมายแห่งความเจริญรุ่งเรืองมีหลายแนวทางด้วยกันที่ต้องอาศัยทักษะต่างๆ ประกอบกัน ซึ่งแนวทางของแต่ละคนอาจแตกต่างกันไป ดังนั้น จึงต้องการให้มนุษย์มีความสามารถในการคิด สามารถกำหนดเป้าหมาย และเลือกแนวทางที่ดีที่สุดได้ ซึ่งแนวคิดดังกล่าวได้เข้าไปเกี่ยวข้องกับเทคโนโลยีสารสนเทศ และถูกนำมาใช้ในงานวิจัยของนักคิดที่เกี่ยวข้องกับเทคโนโลยีดิจิตอลอย่าง Norbert Wiener (1954) ซึ่งได้รับขนานนามว่าเป็นบิดาแห่งเทคโนโลยีดิจิตอล และในระยะต่อมาก็ยังมีงานวิจัยอีกจำนวนมากที่พยายามประยุกต์ใช้แนวคิดดังกล่าวเพื่อค้นหาแนวทางให้มนุษย์สามารถดำรงชีวิตในสังคมแห่งเทคโนโลยีได้อย่างลงตัว (Bernd Carsten Stahl, 2021)

ซึ่งหลังจากเทคโนโลยีสารสนเทศในรูปของอินเตอร์เน็ตได้รับการพัฒนาอย่างก้าวกระโดดในช่วงทศวรรษที่ 1980 ก็เริ่มมีการนำแนวคิดด้านจริยธรรมมาใช้ในการพิจารณาเทคโนโลยีอินเตอร์เนต ต่อมาเมื่อมีการนำอินเตอร์เน็ตมาปรับใช้กับคอมพิวเตอร์ที่ทำให้เกิดการเชื่อมโยงระหว่างคอมพิวเตอร์นับล้านเครื่องทั่วโลกในช่วงทศวรรษ 1990 เกิดการเชื่อมโยงข้อมูลและพัฒนาระบบการประมวลผลที่คาดว่าจะส่งผลกระทบต่อชีวิตของมนุษย์มากขึ้น นักวิชาการจากสาขาปรัชญาและมนุษยศาสตร์จึงเริ่มวิพากษ์เกี่ยวกับบทบาทของเทคโนโลยีในแง่มุมของจริยธรรม อย่างไรก็ตาม ในช่วงแรกของการพัฒนาเทคโนโลยีดังกล่าว นักวิชาการต่างๆก็มองเพียงประเด็นเรื่องความเท่าเทียม เสรีภาพ และการเปิดกว้างเท่านั้น ยังไม่ได้พิจารณาไปถึงผลกระทบทางลบของเทคโนโลยีที่มีต่อสังคมมนุษย์ จนกระทั่งเมื่อมีการใช้เทคโนโลยีเพิ่มขึ้นแพร่หลายไปยังพื้นที่ต่างๆ ทั่วโลกจึงทำให้แนวคิด Computer ethics เข้ามามีบทบาทด้านการตัดสินคุณค่าทางจริยธรรมมากขึ้นเพราะนักวิชาการต่างก็เริ่มกังวลถึงผลกระทบทางลบที่มีต่อมนุษย์ โดยในระยะแรกแนวคิดเกี่ยวกับ Computer ethics ได้ให้ความสำคัญทั้งประเด็นด้านเทคโนโลยีและสังคม โดยมีการค้นพบว่าการพัฒนาเทคโนโลยีและลักษณะเฉพาะของโลกออนไลน์มีส่วนทำให้ข้อจำกัดด้านจริยธรรมอ่อนแอลง จึงมีความจำเป็นต้องออกแบบกฎระเบียบสำหรับควบคุมสังคมออนไลน์ที่เน้นการกำหนดหน้าที่และความรับผิดชอบให้ผู้ที่อยู่ในโลกออนไลน์ (Yufei Liu, 2023)

ทั้งนี้ เมื่อพิจารณาจริยธรรมที่เกี่ยวเนื่องกับปัญญาประดิษฐ์ สิ่งแรกที่ควรทำความเข้าใจคือ การทำความเข้าใจเกี่ยวกับปัญญาประดิษฐ์ว่าวัตถุประสงค์ในการพัฒนาปัญญาประดิษฐ์สามารถที่จำเป็นไปเพื่อสิ่งใดได้บ้าง ซึ่งหากนำแนวคิดข้างต้นมาพิจารณาประกอบก็อาจกล่าวได้ว่า การตัดสินคุณค่าทางจริยธรรมของปัญญาประดิษฐ์อาจแบ่งได้ออกเป็น 3 มิติ คือ การพิจารณาด้านประสิทธิภาพ การพิจารณาในมิติของการออกกฎเกณฑ์ควบคุม และการพิจารณาในมิติของความเจริญรุ่งเรืองของมนุษย์ (ภาพที่ 2)

ภาพที่ 2 การพิจารณาวัตถุประสงค์ของปัญญาประดิษฐ์บนพื้นฐานของหลักจริยธรรม

ที่มา: Bernd Carsten Stahl (2021)

เมื่อพิจารณาแนวนโยบายที่ถูกออกแบบเพื่อกำกับดูแลปัญญาประดิษฐ์ ก็พบว่า การออกแบบแนวนโยบายดังกล่าวมีพื้นฐานความคิด และแรงจูงใจมาจากแนวคิดด้านจริยธรรมทั้งสามแนวคิด โดยอาจมองว่าการพัฒนาปัญญาประดิษฐ์ก็เพื่อสร้างอรรถประโยชน์ให้แก่มนุษย์ผ่านการช่วยเพิ่มประสิทธิภาพเพื่อลดต้นทุนและก่อให้เกิดประโยชน์เชิงเศรษฐกิจ ดังที่คณะกรรมาธิการสหภาพยุโรปได้กล่าวไว้ว่า ปัญญาประดิษฐ์จะเข้ามาช่วยเพิ่มประสิทธิภาพในการผลิตของภาคอุตสาหกรรมและทำให้เกิดการเติบโตของระบบเศรษฐกิจ (Craglia et al. 2018 referred in Bernd Carsten Stahl, 2021) ในขณะเดียวกัน เมื่อมองในมิติของการกำกับดูแลเชิงควบคุมภายใต้แนวคิด Deontology ก็พบว่า ปัญญาประดิษฐ์ถูกสร้างขึ้นมาเพื่อควบคุมพฤติกรรมมนุษย์ เช่น ในกรณีของจีนที่ปัญญาประดิษฐ์ถูกนำมาใช้ในการรวบรวมข้อมูลขนาดใหญ่และประมวลผล เพื่อนำมาใช้ในการให้คะแนนพฤติกรรมเพื่อจูงใจให้คนในสังคมปฏิบัติตามกฎเกณฑ์ที่ภาครัฐกำหนดขึ้น (Mullainathan and Thaler 2000, Camerer et al. 2004 , Creemers 2018, Liu 2019 referred in Bernd Carsten Stahl, 2021)

ในส่วนของการพิจารณาจริยธรรมภายใต้แนวคิด Flourishing ethics ก็พบว่า การพัฒนาปัญญาประดิษฐ์อาจเป็นไปเพื่อความเจริญรุ่งเรืองของมนุษย์ โดยสามารถใช้ปัญญาประดิษฐ์เป็นเครื่องมือช่วยในการระบุเป้าหมายที่มีคุณค่าและสนับสนุนให้มนุษย์ค้นหาแนวทางในการบรรลุเป้าหมายที่วางไว้ เช่นกรณีของปัญญาประดิษฐ์ที่ถูกนำไปปรับใช้ในการสร้างสังคมที่ดี “good AI society” (Cath et al. 2016 referred in Bernd Carsten Stahl, 2021)

อย่างไรก็ตาม เมื่อนำแนวคิดด้านจริยธรรมทั้งสามมาปรับใช้ในการพิจารณาจริยธรรมของปัญญาประดิษฐ์ก็อาจเกิดความขัดแย้งกัน ตัวอย่างเช่น การนำปัญญาประดิษฐ์มาใช้เพื่อเพิ่มอรรถประโยชน์ของมนุษย์ในรูปของการทำให้เศรษฐกิจเติบโตมากขึ้นภายใต้แนวคิด Consequentialism ก็อาจนำมาซึ่งผลกระทบทางลบต่อคุณภาพชีวิตของมนุษย์ หรือหากต้องการพัฒนาเทคโนโลยีสะอาดเพื่อตอบสนองแนวคิด Flourishing ethics ก็อาจลดทอนประสิทธิภาพและทำให้อรรถประโยชน์ของมนุษย์ลดลง หรือหากต้องการนำปัญญาประดิษฐ์มาปรับใช้เพื่อควบคุมคนในสังคมภายใต้แนวคิด Deontology ก็มักจะเกิดความขัดแย้งกับแนวคิดอื่นๆ เช่น ทำให้เกิดการละเมิดสิทธิและเสรีภาพของบุคคล (Lyon 2001 referred in Bernd Carsten Stahl, 2021) แต่อย่างไรก็ตาม เป้าหมายของแนวคิดทั้งสามก็อาจทำให้สอดคล้องกันได้ หากมีการออกแบบระบบการกำกับดูแลปัญญาประดิษฐ์ที่ดีเพียงพอ เช่น หากยังคงต้องการคงไว้ซึ่งหลักการของ Flourishing ethics โดยมีเป้าหมายเพื่อพัฒนาสังคมมนุษย์ที่เน้นการสร้างสุขภาพที่ดี ก็อาจออกแบบกฎเกณฑ์เพื่อควบคุมพฤติกรรมอย่างเหมาะสม ซึ่งจะเห็นได้จากการออกแบบกฎเกณฑ์ของภาครัฐในหลายๆ ประเทศ เช่น สหราชอาณาจักร ออสเตรเลีย เยอรมนี และสหรัฐอเมริกา ที่ภาครัฐสร้างแรงจูงใจผ่านมาตรการต่างๆ เพื่อให้คนฉีดวัคซีนป้องกันไข้หวัดใหญ่ที่ส่งผลให้คนมีสุขภาพที่ดีขึ้นตามเป้าหมายในการพัฒนาที่วางไว้ (Benartzi et al. 2017 referred in Bernd Carsten Stahl, 2021) หรือในกรณีที่มีการนำเทคโนโลยีปัญญาประดิษฐ์มาปรับใช้เพื่อควบคุมคนในสังคมก็อาจช่วยเต็มเติมเป้าหมายในการพัฒนาได้ เช่น การนำปัญญาประดิษฐ์มาใช้ในการดำเนินมาตรการของรัฐเพื่อช่วยติดตามและเก็บข้อมูลผู้ติดเชื้อก็มีส่วนช่วยป้องกันโรคให้คนในสังคมไปพร้อมๆ กัน (Klar and Lanzerath 2020 referred in Bernd Carsten Stahl, 2021)

จากที่กล่าวมาข้างต้น จะเห็นว่า เราสามารถมองจริยธรรมปัญญาประดิษฐ์ได้หลายแง่มุมผ่านแนวคิดด้านจริยธรรมรูปแบบต่างๆ ซึ่งที่ผ่านมา แนวคิดด้านจริยธรรมปัญญาประดิษฐ์ได้รับการพัฒนาขึ้นอย่างต่อเนื่องจนเริ่มมีความเป็นรูปธรรมมากขึ้น ซึ่งแนวคิดที่เป็นหลักสากลที่เป็นที่นิยมกล่าวถึง คือ แนวทางจริยธรรมปัญญาประดิษฐ์ (AI ethics guidelines) ที่กล่าวถึงในบทความของ Jobin et al. 2019 referred in Nancy S. Jecker and Eisuke Nakazawa, 2022) ซึ่งได้ค้นหาแนวทางจริยธรรมปัญญาประดิษฐ์จากเอกสารทางวิชาการหลายฉบับทั่วโลกทั้งที่พัฒนาโดยหน่วยงานภาครัฐและเอกชน เพื่อนำมาประมวลและสรุปออกมาเป็นคุณค่าหลัก 5 มิติ ได้แก่

- ความโปร่งใส

- ความเป็นธรรม

- ความปลอดภัย

- ความรับผิดชอบ

- ความเป็นส่วนตัว

และในขณะเดียวกันก็ยังมีคุณค่าอื่นๆ ที่ Jobin et al. 2019 ระบุว่าเป็นคุณค่าลำดับรองอีก 6 มิติ ได้แก่

- ความเป็นประโยชน์ต่อส่วนรวม

- ความมีอิสรภาพและความเป็นเอกภาพ

- ความไว้วางใจ

- ความยั่งยืน

- ศักดิ์ศรีความเป็นมนุษย์

- ความสามัคคี

ซึ่งแต่ละมิติดังกล่าวก็มีความเกี่ยวโยงกับหลักจริยธรรมที่แตกต่างกันไป นอกจากนี้ ยังมีแนวคิดจริยธรรมปัญญาประดิษฐ์ที่ได้รับการกล่าวถึงในวงกว้างทีได้รับการพัมนาขึ้นโดยประเทศในสหภาพยุโรป ซึ่งก็คือ The ethics guidelines for trustworthy AI (the EU’s High-Level Expert Group on Artificial Intelligence, 2019 referred in Bernd Carsten Stahl, 2021) ที่เป็นแนวทางจริยธรรมที่มุ่งเน้นให้เกิดการพัฒนาปัญญาประดิษฐ์บนพื้นฐานหลักจริยธรรม 4 ข้อ คือ ความเป็นอิสรภาพของมนุษย์ ความปลอดภัย ความเป็นธรรม และความสามารถในการอธิบายให้เข้าใจได้อย่างชัดเจน

ในส่วนของประเทศไทย เมื่อไม่นานมานี้ สำนักงานพัฒนาวิทยาศาสตร์และเทคโนโลยีแห่งชาติก็ได้พัฒนาแนวปฏิบัติจริยธรรมด้านปัญญาประดิษฐ์โดยพิจารณาจากกฎเกณฑ์การกำกับดูแลทั้งที่มีอยู่ในประเทศไทยและในต่างประเทศ เช่น แนวทางจริยธรรมสำหรับปัญญาประดิษฐ์ที่น่าเชื่อถือ (Ethics guidelines for trustworthy AI) โดยกลุ่มผู้เชี่ยวชาญระดับสูงด้านปัญญาประดิษฐ์ของคณะกรรมาธิการยุโรป (High-Level Expert Group on Artificial Intelligence) และเอกสารแนวปฏิบัติจริยธรรมปัญญาประดิษฐ์ (Thailand AI Ethics Guideline) ของสำนักงานคณะกรรมการดิจิทัลเพื่อเศรษฐกิจและสังคมแห่งชาติ กระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม เพื่อใช้เป็นแนวปฏิบัติในการวิจัย ออกแบบ พัฒนา ประยุกต์ใช้ และถ่ายทอดเทคโนโลยีด้านปัญญาประดิษฐ์ และวิทยาศาสตร์ข้อมูลที่ใช้ปัญญาประดิษฐ์หรืออัลกอริทึมที่ขับเคลื่อนด้วยข้อมูล และยังอยู่บนพื้นฐานของหลักการสากล 7 ข้อ (สำนักงานพัฒนาวิทยาศาสตร์และเทคโนโลยีแห่งชาติ, 2566) ได้แก่

- ความเป็นส่วนตัว (privacy)

- ความมั่นคงและปลอดภัย (security and safety)

- ความไว้วางใจ (reliability)

- ความเป็นธรรม เท่าเทียม และไม่แบ่งแยก (fairness and non-discrimination)

- ความโปร่งใสและอธิบายได้ (transparency and explainability)

- ภาระความรับผิด (accountability)

- หลักการที่มนุษย์เป็นผู้ควบคุมปัญญาประดิษฐ์ เพื่อความยั่งยืนของมนุษยชาติ (human oversight and human agency)

ไม่เพียงแต่หน่วยงานภาครัฐที่มีบทบาทในการกำหนดแนวทางจริยธรรม ธุรกิจที่เกี่ยวข้องกับปัญญาประดิษฐ์หลายรายก็เริ่มให้ความสำคัญกับการออกแบบแนวทางจริยธรรมเพื่อนำมาปรับใช้ในองค์กรเช่นกัน เช่น กรณีของบริษัท Microsoft ได้นำแนวคิดข้างต้นมาปรับใช้ในการพัฒนาแนวทางจริยธรรมปัญญาประดิษฐ์ที่ประกอบ 6 มิติ (สำนักงานส่งเสริมเศรษฐกิจดิจิทัล) ได้แก่

- การปฏิบัติต่อทุกคนอย่างเป็นธรรม (Fairness)

- ความน่าเชื่อถือและปลอดภัย (Reliability & Safety)

- การเคารพความเป็นส่วนตัว (Privacy)

- การสนับสนุนการมีส่วนร่วม (Inclusiveness)

- อัลกอลิทึมที่มีความรับผิดชอบ (Accountability)

- เป็นที่เข้าใจได้และโปร่งใส (Transparency)

ในส่วนของแนวทางจริยธรรมปัญญาประดิษฐ์ของบริษัท Google ก็ถูกออกแบบโดยพิจารณาหลักจริยธรรมเช่นเดียวกับหลักการข้างต้น แต่ขยายความครอบคลุมไปสู่กิจกรรมที่กว้างมากขึ้น ได้แก่

- ความเป็นประโยชน์ต่อสังคม (Be Socially Beneficial)

- การหลีกเลี่ยงการสร้างหรือสนับสนุนความอคติที่ไม่เป็นธรรม (Avoid Creating or Reinforcing Unfair Bias)

- การกำหนดให้ระบบปัญญาประดิษฐ์ต้องถูกสร้างและทดสอบสำหรับความปลอดภัย (Be Built and Tested for Safety) เพื่อหลีกเลี่ยงผลลัพธ์ที่ไม่พึงประสงค์และก่อให้เกิดอันตราย

- การมีความรับผิดชอบต่อมนุษย์ (Be Accountable to People

- การคำนึงถึงหลักการความเป็นส่วนตัว (Incorporate Privacy Design Principles) ด้วยความโปร่งใสและการควบคุมการใช้ข้อมูลส่วนบุคคล

- การสนับสนุนการก้าวไปสู่การสร้างมาตรฐานใหม่ของความเป็นเลิศทางด้านวิทยาศาสตร์ในระดับสูง (Uphold High Standards of Scientific Excellence)

นอกจากแนวทางจริยธรรมข้างต้น บริษัท Google ยังออกแบบแนวปฏิบัติที่ดีของปัญญาประดิษฐ์ที่มีความรับผิดชอบ (Responsible AI Practices) เพื่อทำให้หลักการข้างต้นสมบูรณ์ยิ่งขึ้น ได้แก่

- ยึดหลักมนุษย์เป็นศูนย์กลางในการออกแบบ (Use a human-centered design approach)

- ระบุตัวชี้วัดที่มากเพียงพอเพื่อประเมินการฝึกและการติดตาม (Identify multiple metrics to assess training and monitoring)

- เมื่อเป็นไปได้ให้ตรวจสอบข้อมูลดิบโดยตรง (When possible, directly examine your raw data)

- เข้าใจข้อจำกัดของชุดข้อมูลและโมเดล (Understand the limitations of your dataset and model)

- ทดสอบ ทดสอบ และทดสอบ (Test Test and Test) เพื่อให้ระบบปัญญาประดิษฐ์สามารถได้รับความเชื่อถือได้

- ทำการตรวจสอบและปรับปรุงระบบอย่างต่อเนื่องหลังจากนำไปใช้งาน (Continue to monitor and update the system after deployment)

อีกองค์กรหนึ่งที่น่าสนใจคือ บริษัท DeepMind ซึ่งเป็นบริษัทปัญญาประดิษฐ์สัญชาติอังกฤษที่เป็นเจ้าของ AlphaGo ซึ่งภายใต้การดำเนินการของ Alphabet ได้ดำเนินการจัดตั้งหน่วยวิจัยจริยธรรมด้านปัญญาประดิษฐ์ที่ชื่อว่า DeepMind Ethics & Society ที่มีการออกแบบหลักจริยธรรมปัญญาประดิษฐ์มาปรับใช้กับการวิจัย ซึ่งประกอบด้วยหลักจริยธรรม 6 มิติ (สำนักงานส่งเสริมเศรษฐกิจดิจิทัล) ได้แก่

- ความเป็นส่วนตัว ความโปร่งใส และความยุติธรรม (Privacy, Transparency and Fairness)

- ผลกระทบต่อเศรษฐกิจด้านความมีส่วนร่วมและความเท่าเทียม (Economic Impact: Inclusion and Equality)

- การกำกับดูแลและความรับผิดชอบ (Governance and Accountability)

- การจัดการความเสี่ยงที่เกิดขึ้นจากปัญญาประดิษฐ์ โดยเฉพาะอย่างยิ่งประเด็นการใช้ในทางที่ผิดและผลลัพธ์ที่ไม่ได้ตั้งใจ (Managing AI Risk: Misuse and Unintended Consequences)

- ศีลธรรมและคุณค่าของปัญญาประดิษฐ์ (AI Morality and Values)

- ปัญญาประดิษฐ์และการแก้ไขปัญญาอันซับซ้อนบนโลก (AI and the World’s Complex Challenges)]

ความหลากหลายของแนวคิดด้านจริยธรรมปัญญาประดิษฐ์ที่ถูกพัฒนาขึ้นอย่างต่อเนื่องในประเทศต่างๆ ทั่วโลก ทำให้ที่ผ่านมามีงานวิจัยจำนวนมากที่พยายามนำแนวทางจริยธรรมมาใช้ในการศึกษาค้นคว้าเพื่อต่อยอดการพัฒนามากขึ้น โดยเฉพาะในประเด็นของการปรับปรุงแนวทางจริยธรรมให้สอดรับกับบริบทของคนกลุ่มต่างๆ ทั่วโลก ซึ่งจากการทบทวนงานวิจัยที่เกี่ยวข้องกับการศึกษาแนวคิดเกี่ยวกับจริยธรรมปัญญาประดิษฐ์ พบว่า งานวิจัยส่วนใหญ่จะใช้วิธีการทบทวนวรณกรรมเพื่อรวบรวมข้อมูลจากงานวิจัยและเอกสารทางวิชาการต่างๆ มาใช้เพื่อวิเคราะห์ถึงปัญหาและแนวทางในการพัฒนาแนวทางจริยธรรมปัญญาประดิษฐ์ที่ให้ความสำคัญกับความแตกต่างทางวัฒนธรรมมากขึ้น เช่น งานวิจัยของ Rifat Ara Shams et al. (2023) ที่ทบทวนเอกสารทางวิชาการจำนวนมากตลอดช่วงปี 2017-2022 ที่เกี่ยวข้องกับประเด็นด้านความหลากหลายและการมีส่วนร่วมอันเกี่ยวเนื่องกับการออกแบบแนวทางจริยธรรมปัญญาประดิษฐ์ด้วยวิธีที่เรียกว่า Systematic literature review โดยทบทวนในประเด็นที่เป็นปัญหาและแนวทางในการแก้ไขปัญหาตลอดห่วงโซ่คุณค่าของปัญญาประดิษฐ์ ตั้งแต่การออกแบบ การพัฒนา และการนำปัญญาประดิษฐ์ไปใช้ประโยชน์ ซึ่งจากการวิจัยดังกล่าวได้รวบรวมปัญหาที่เกิดจากการขาดการคำนึงถึงความแตกต่างและการมีส่วนร่วม ซี่งก่อให้เกิดปัญหาต่างๆ ในสังคม เช่น ปัญหาด้านความไม่เป็นธรรมอันเกิดจากการออกแบบแนวทางจริยธรรมที่ไม่เหมาะสม ในขณะเดียวกัน จากการทบทวนงานวิจัยก็ค้นพบแนวทางในการแก้ไขปัญหาดังกล่าวจำนวนมาก เช่น การปรับปรุงระบบการเทรนด์ปัญญาประดิษฐ์ การเปิดโอกาสให้คนกลุ่มต่างๆ เข้ามามีส่วนร่วมในการออกแบบปัญญาประดิษฐ์ ซึ่งข้อค้นพบต่างๆ ที่เกิดขึ้นก็นำมาสรุปเป็นองค์ความรู้ที่น่าสนใจที่สามารถนำไปปรับใช้ต่อยอดในการพัฒนาแนวทางการกำกับดูแลปัญญาประดิษฐ์ต่อไป

ในขณะที่บางงานวิจัยก็มุ่งทบทวนเอกสารทางวิชาการเพื่อนำข้อมูลมาวิพากษ์ปัญหาการผูกขาดการมีส่วนร่วมในการกำหนดแนวทางจริยธรรม และค้นหาแนวทางแก้ปัญหาความแตกต่างของคุณค่าทางจริยธรรมระหว่างชาติตะวันตกที่เป็นชาติที่มีอิทธิพลในการพัฒนาแนวทางจริยธรรมปัญญาประดิษฐ์มาโดยตลอด และคุณค่าในมุมมองของประเทศในภูมิภาคอื่นๆ เช่น Cathy Roche et al (2022) ได้ศึกษาบทบาทของประเทศกำลังพัฒนากลุ่มที่เรียกว่า Global South ในการเข้าไปมีส่วนรวมออกแบบแนวทางจริยธรรมปัญญาประดิษฐ์ผ่านการทบทวนเอกสารทางวิชาการที่เกี่ยวข้องกับประเด็นดังกล่าวหลายร้อยฉบับ ซึ่งจากการศึกษาพบว่า ประเทศกลุ่ม Global South มีบทบาทน้อยมาก ในขณะที่ประเทศที่มีอิทธิพลต่อการพัฒนาแนวทางจริยธรรมมักจะเป็นกลุ่มประเทศพัฒนาแล้วทางตอนเหนือ เช่น ยุโรป อเมริกาเหนือ และการพัฒนาแนวทางดังกล่าวก็ยังไม่ได้นำปัจจัยด้านความแตกต่างทางวัฒนธรรมเข้ามาร่วมพิจารณามากนัก ซึ่งจากการศึกษาดังกล่าวนำมาซึ่งข้อเสนอแนะเชิงนโยบายให้การออกแบบแนวทางจริยธรรมเปิดโอกาสให้คนกลุ่มที่มีความแตกต่างทางวัฒนธรรมมามีส่วนร่วมมากขึ้น นอกจากนี้ ยังมีบทความของ Emmanuel R. Goffi (2021) ที่ศึกษาเอกสารทางวิชาการที่มีการค้นหาแหล่งที่มาของแนวทางจริยธรรม เช่น งานศึกษาของ Yannick Meneceur ซึ่งพบว่าแนวทางส่วนใหญ่มาจากผู้พัฒนาในชาติตะวันตก เช่นสหรัฐอเมริกา สหราชอาณาจักร และมีรากฐานมาจากแนวคิดด้านจริยธรรมที่กำหนดไว้ในอดีต โดยเฉพาะแนวคิด Deontological จึงนำมาซึ่งข้อกังวลเกี่ยวกับอิทธิพลทางความคิดของชาติตะวันตกที่จะเข้ามาครอบงำการตัดสินคุณค่าทางจริยธรรมและอาจทำให้ละเลยความแตกต่างทางวัฒนธรรมที่มีผลต่อคุณค่าทางจริยธรรมดังกล่าว นอกจากนี้ ยังยกตัวอย่างกรณีของจีนที่มีความแตกต่างทางวัฒนธรรมอย่างมากเมื่อเทียบกับชาติตะวันตก ทั้งที่จีนมีอิทธิพลอย่างมากในการพัฒนาเทคโนโลยีปัญญาประดิษฐ์แต่ในการออกแบบแนวทางจริยธรรมกลับไม่ได้เข้ามามีส่วนร่วมมากนัก เช่นเดียวกับอีกหลายๆ ประเทศ เช่น ประเทศแถบลาตินอเมริกา แอฟริกา รวมทั้งประเทศที่นับถือศาสนาอิสลาม ในขณะที่ประเทศพัฒนาแล้วอย่างแคนาดาและนิวซีแลนด์ ไม่เพียงแต่มีอิทธิพลในการออกแบบแนวทางจริยธรรม แต่กลับให้ความสำคัญกับบรรทัดฐานทางวัฒนธรรมของชนกลุ่มน้อยในการออกแบบแนวทางจริยธรรม ซึ่งจากงานศึกษาดังกล่าวจึงเสนอแนะให้มีการเปิดโอกาสให้ทุกประเทศเข้ามามีส่วนในการออกแบบแนวทางจริยธรรมปัญญาประดิษฐ์เพื่อนำมุมมองและบรรทัดฐานทางวัฒนธรรมที่แตกต่างกันเข้ามาพิจารณามากขึ้น

ในขณะที่งานวิจัยของ Nancy S. Jecker and Eisuke Nakazawa (2022) ที่ตีพิมพ์บทความเรื่อง Bridging East-West Differences in Ethics Guidance for AI and Robotics ได้ศึกษาแนวทางด้านจริยธรรมปัญญาประดิษฐ์ที่ส่วนใหญ่ริเริ่มจากชาติตะวันตกจากเอกสารทางวิชาการ โดยมุ่งแนวทางที่ริเริ่มพัฒนาโดย Jobin et al. 2019 มาพิจารณาในมุมมองของชาติตะวันออกอย่างญี่ปุ่นเพื่อค้นหาคุณค่าร่วมกันเพื่อออกแบบแนวทางในการพัฒนาที่สอดรับกับบรรทัดฐานทางวัฒนธรรมของแต่ละประเทศ ซึ่งจากการศึกษาได้นำมาซึ่งข้อสรุปในการขยายความมิติของจริยธรรมที่ประมวลโดย Jobin et al. 2019 ดังตารางที่ 1

ตารางที่ 1 แนวทางจริยธรรมปัญญาประดิษฐ์ที่บูรณาการคุณค่าของชาติตะวันตกและญี่ปุ่นเข้าด้วยกัน

| คุณค่า | ผลลัพธ์ที่เกิดขึ้น |

| ความโปร่งใส | การแสวงหาผลประโยชน์จากการบิดเบือนข้อมูล |

| ความเป็นธรรม | อคติที่ทำให้เกิดความไม่เป็นธรรมต่อคนด้อยโอกาส |

| การป้องกันอันตราย | อันตรายทางกายภาพและต่อสภาพจิตใจ |

| ความรับผิดชอบ | การปัดความรับผิดชอบ เนื่องจากไม่มีการระบุภาระรับผิดชอบที่ชัดเจน |

| ความเป็นส่วนตัว | การละเมิดความเป็นส่วนตัว |

| สิ่งที่ควรเกิดขึ้น | ประโยชน์ที่จะได้รับ |

| การสร้างคุณประโยชน์ | ทำให้มนุษย์มีความเป็นอยู่ที่ดีขึ้น |

| เสรีภาพและเอกภาพ | เสรีภาพของมนุษย์ในการเลือกที่จะกระทำในสิ่งที่ต้องการ |

| ความไว้วางใจ | เกิดความสัมพันธ์ที่ดีต่อกันระหว่างมนุษย์และหุ่นยนต์ |

| ความยั่งยืน | สนับสนุนการดูแลสภาพแวดล้อมและการพัฒนาที่ยั่งยืน |

| ความมีศักดิ์ศรี | สนับสนุนความสามารถพื้นฐานของมนุษย์ |

| ความสามัคคี | หุ่นยนต์เข้าไปมีบทบาทในการสนับสนุนความสัมพันธ์ทางสังคมที่มีคุณค่า |

แหล่งที่มา: Nancy S. Jecker and Eisuke Nakazawa (2022)

งานวิจัยอื่นๆ ที่น่าสนใจ ได้แก่ งานวิจัยของ Soraj Hongladarom and Jerd Bandasak (2023) ซึ่งได้ศึกษาแนวทางจริยธรรมปัญญาประดิษฐ์ของประเทศที่ไม่ใช่กลุ่มชาติตะวันตก เพื่อศึกษามุมมองที่มีต่อการพัฒนาแนวทางจริยธรรมว่าจะเป็นไปในทิศทางใดและมีความแตกต่างจากแนวทางของประเทศอื่นๆ อย่างไร ซึ่งในการศึกษาได้รวมถึงแนวทางจริยธรรมปัญญาประดิษฐ์ของประเทศไทยที่มีมุมมองต่างไปจากประเทศอื่น แทนที่จะให้ความสำคัญกับมิติทางจริยธรรมอันเป็นสากล กลับไปมุ่งเน้นการเพิ่มความสามารถในการแข่งขัน เป็นต้น นอกจากนี้ ยังมีงานวิจัยของ Yufei Liu (2023) ที่เผยแพร่ในบทความ Cross-Cultural Challenges to Artificial Intelligence Ethics ที่ให้ความสำคัญกับการนำบรรทัดฐานทางวัฒนธรรมที่แตกต่างกันระหว่างประเทศต่างๆ เข้ามาพิจารณาร่วมกับแนวคิดด้านจริยธรรมปัญญาประดิษฐ์ โดยศึกษาแนวคิดด้านจริยธรรมที่ถูกพัฒนาขึ้นในยุคเทคโนโลยีสารสนเทศที่เรียกว่า Computer ethics ซึ่งถูกนำมาปรับใช้ในการออกแบบกฎระเบียบสำหรับควบคุมสังคมออนไลน์ที่เน้นการกำหนดหน้าที่และความรับผิดชอบให้ผู้ที่อยู่ในโลกออนไลน์ อย่างไรก็ตาม เนื่องจากความแตกต่างทางวัฒนธรรมระหว่างประเทศต่างๆ ทำให้การนำแนวคิดดังกล่าวมาประยุกต์ใช้ในการออกแบบกฎระเบียบมีความแตกต่างกันไปตามแต่ละวัฒนธรรม โดยกลุ่มประเทศที่นำมาศึกษาครั้งนี้ได้แก่ สหรัฐ เยอรมนี ญี่ปุ่น ซึ่งจากการศึกษาก็ได้ค้นพบข้อสรุปของความแตกต่างในมุมมองที่มีจริยธรรมที่แตกต่างกัน เช่น ในกรณีของกฎหมายด้านเทคโนโลยีสารสนเทศของญี่ปุ่นได้ให้ความสำคัญกับผลกระทบของเทคโนโลยีที่มีต่อสังคมส่วนรวมอย่างชัดเจน ในส่วนของเยอรมนี กฎหมายที่ใช้ในการควบคุมสังคมออนไลน์ได้พยายามสร้างความสมดุลระหว่างการทำตามกฎระเบียบและเสรีภาพไปพร้อมๆ กัน ในขณะที่กฎหมายของสหรัฐจะมุ่งเน้นการให้เสรีภาพในการแสดงออกมากกว่าประเด็นอื่นๆ ซึ่งมีส่วนทำให้การบังคับใช้กฎหมายเพื่อควบคุมสังคมออนไลน์ไม่เข้มงวดมากเท่าที่ควร

นอกจากนี้ ในช่วงไม่กี่ปีมานี้ มีงานวิจัยจำนวนมากขึ้นที่ให้ความสำคัญกับประเด็นด้านความหลากหลายและการอยู่ร่วมกัน (Diversity and Inclusion) กับเทคโนโลยีปัญญาประดิษฐ์ ในแง่มุมต่างๆ โดยมีงานวิจัยที่น่าสนใจ เช่น งานวิจัยของ Didar Zowghi and Muneera Bano (2024) ได้ศึกษาช่องว่างในการวิจัยที่ผ่านมาเกี่ยวกับความหลากหลายและการอยู่ร่วมกันกับเทคโนโลยีปัญญาประดิษฐ์ผ่านการทบทวนวรรณกรรมอย่างเป็นระบบ (Systematic Literature Review) โดยสำรวจข้อมูลเพื่อค้นหาคำตอบเกี่ยวกับแนวทางและความท้าทายที่จะนำประเด็นด้านความหลากหลายและการอยู่ร่วมกันไปใช้ในกระบวนการพัฒนาเทคโนโลยีปัญญาประดิษฐ์และปัญญาประดิษฐ์จะเข้าไปมีส่วนช่วยสนับสนุนประเด็นดังกล่าวได้อย่างไรบ้าง ซึ่งจากการวิจัยพบว่า งานวิจัยส่วนใหญ่ยังไม่ได้มุ่งเน้นการศึกษาบทบาทของปัญญาประดิษฐ์จะเข้าไปมีส่วนช่วยสนับสนุนประเด็นดังกล่าวมากนัก แต่จะมุ่งเน้นการศึกษาเพื่อวิพากษ์เกี่ยวกับความหลากหลายและการอยู่ร่วมกันที่เข้าไปเกี่ยวข้องกับกระบวนการพัฒนาหรือใช้ประโยชน์จากเทคโนโลยีปัญญาประดิษฐ์ โดยส่วนใหญ่จะมุ่งวิพากษ์ประเด็นเกี่ยวกับเพศเป็นหลัก ในขณะที่ประเด็นด้านเชื้อชาติและภาษากลับไม่ค่อยมีการวิจัยมากนัก ดังนั้น จากช่องว่างที่มีอยู่จึงนำมาสู่การศึกษาและนำเสนอกรณีที่น่าสนใจในประเด็นเกี่ยวกับบทบาทของปัญญาประดิษฐ์จะเข้าไปมีส่วนช่วยสนับสนุนความหลากหลายและการอยู่ร่วมกันในมิติที่กว้างขึ้น ซึ่งตัวอย่างบทความวิจัยที่ Didar Zowghi and Muneera Bano นำมาเสนอ ได้แก่ บทความวิจัยเรื่อง “AI Empowered Auslan Learning for Parents of Deaf Children and Children of Deaf Adults” ซึ่งผู้ประพันธ์ได้ยกตัวอย่างกรณีของการพัฒนาเทคโนโลยีปัญญาประดิษฐ์ในรูปของเครื่องแปลภาษาแบบสองทางเพื่อช่วยสนับสนุนครอบครัวที่มีคนพิการทางหู ในส่วนของบทความวิจัย “Gender Tapestry: Gender Classification as Color Assignation” เป็นงานวิจัยเพื่อพัฒนางานศิลป์ที่ผสานมุมมองที่แตกต่างกันของคนกลุ่มที่มีความหลากหลายทางเพศ ในขณะที่บทความวิจัย “The Digital Divide in Action: How Experiences of Digital Technology Shape Future Relationships with Artificial Intelligence” ซึ่งผู้ประพันธ์ได้ให้ความสำคัญกับการแก้ปัญหาการแบ่งแยกทางสังคมที่เกิดจากปัญญาประดิษฐ์จึงได้ออกแบบแนวทางในการสร้างความเชื่อมั่นในเทคโนโลยีดิจิตอลให้แก่คนกลุ่มต่างๆ ที่ด้อยโอกาส เพื่อนำไปสู่สังคมที่คนแต่ละกลุ่มเข้ามามีส่วนร่วมในพัฒนาและใช้ประโยชน์จากเทคโนโลยีดังกล่าว และอีกบทความหนึ่ง คือ “The Ethical Implications of Chatbot Developments for Conservation Expertise” ซึ่งผู้ประพันธ์ก็ได้ศึกษามิติทางจริยธรรมที่เกิดจากการพัฒนาหุ่นยนต์โต้ตอบในรูปแบบต่างๆ เช่น ChatGPT ผ่านการรวบรวมข้อมูลการโต้ตอบที่เกิดขึ้น ซึ่งผลการศึกษาพบว่า เทคโนโลยีดังกล่าวได้นำเสนอข้อมูลที่ยังแฝงด้วยอคติและไม่ได้ให้ความสำคัญกับข้อมูลแต่ละแหล่งอย่างเท่าเทียมกัน โดยในส่วนของ ChatGPT มักเลือกใช้ข้อมูลที่ได้มาจากประเทศที่มีรายได้สูง โดยเฉพาะประเทศแถบอเมริกาเหนือ และบุคคลเพศชายเป็นหลัก เป็นต้น ในขณะที่งานวิจัยของ Eduard Fosch Villaronga and Adam Poulsen (2022) ก็มุ่งศึกษาวิจัยผ่านการทบทวนวรรณกรรมที่เกี่ยวข้องกับผลกระทบของปัญญาประดิษฐ์ที่มีต่อความหลากหลายและการอยู่ร่วมกันทั้งในมิติของแนวคิด ช่องว่างในการวิจัยที่ผ่านมา และกรณีศึกษาเกี่ยวกับผลกระทบที่เกิดขึ้นซึ่งนำไปสู่สังคมที่มีความเหลื่อมล้ำและทำให้คนบางกลุ่มได้รับความไม่เป็นธรรม โดยในการศึกษาข้อมูลจะครอบคลุมผู้ที่เกี่ยวข้องกับปัญญาประดิษฐ์ ได้แก่ นักวิจัยและพัฒนาปัญญาประดิษฐ์ คนในสังคม และผู้ใช้ปัญญาประดิษฐ์ โดยได้นำเสนอผลกระทบที่เกิดขึ้นในมิติต่างๆ เช่น ผลกระทบด้านความเหลื่อมล้ำที่มีต่อกลุ่มสตรี กลุ่มเพศทางเลือก คนพิการ คนสูงวัย เป็นต้น ในขณะเดียวกันก็ได้ศึกษาและนำเสนอแนวทางในการลดผลกระทบดังกล่าว เช่น การปรับปรุงกระบวนการสร้างอัลกิริธึมโดยเปิดโอกาสให้คนกลุ่มต่างๆ เข้ามามีส่วนร่วมมากขึ้น ตลอดจนนโยบายภาครัฐที่ต้องให้ความสำคัญกับการมีส่วนร่วมมากกว่าที่ผ่านมา เพื่อให้เทคโนโลยีปัญญาประดิษฐ์ถูกพัฒนาไปในทางที่จะช่วยสนับสนุนความหลากหลายและการอยู่ร่วมกันในสังคมได้มากขึ้น เช่นเดียวกับงานวิจัยของ Gaelle Cachat-Rosset and Alain Klarsfeld (2023) ซึ่งทบทวนวรรณกรรมในรูปแบบเดียวกัน เพื่อศึกษาแนวทางการออกแบบแนวทางจริยธรรมปัญญาประดิษฐ์ของหน่วยงานต่างๆ ทั้งภาครัฐและเอกชนทั่วโลกโดยเน้นไปที่หลักการสามประการ คือ ความหลากหลาย ความเป็นธรรม และการมีส่วนร่วม (Diversity equity and inclusion (DEI)) ครอบคลุมตลอดห่วงโซ่คุณค่าของปัญญาประดิษฐ์ ตั้งแต่การพัฒนา การนำใช้ประโยชน์ ตลอดจนการกำกับดูแล ซึ่งจากการศึกษาวิจัยนำมาสู่ข้อค้นพบเกี่ยวกับช่องว่างในการออกแบบแนวทางการกำกับดูแลที่ผ่านมา ซึ่งส่วนหนึ่งเป็นปัญหาที่เกิดจากการขาดการเปิดโอกาสให้คนกลุ่มต่างๆ เข้ามามีบทบาทในการออกแบบแนวทางการกำกับดูแล เช่น บทบาทของประเทศตะวันตกที่มากกว่าประเทศกลุ่มอื่นๆ การให้ความสำคัญกับกลุ่มคนด้อยโอกาสทางเทคโนโลยีที่ต่ำเกินไป เป็นต้น ซึ่งนำมาสู่ข้อเสนอแนะในการพัฒนาระบบการกำกับดูแลในอนาคต อีกบทความหนึ่งที่นำเสนอแนวทางและกรณีศึกษาที่น่าสนใจเกี่ยวกับบทบาทของเทคโนโลยีปัญญาประดิษฐ์ที่อยู่บนพื้นฐานของการมีส่วนร่วมและมีจริยธรรม เช่น ในบทความของ Shaip (2024)[1] เกี่ยวกับความสำเร็จของการนำเทคโนโลยีปัญญาประดิษฐ์ไปปรับใช้เพื่อลดช่องว่างความแตกต่างระหว่างคนกลุ่มต่างๆ เช่น กรณีศึกษาเกี่ยวกับการตอบสนองต่อภาวะวิกฤติหลายภาษาหลังจากเกิดภัยพิบัติทางธรรมชาติ โดยการพัฒนา LLM หลายภาษาที่สามารถทำความเข้าใจและแปลภาษาท้องถิ่นและภาษาเฉพาะสำหรับภูมิภาคที่มีแนวโน้มเกิดภัยพิบัติ แบบจำลองนี้ได้รับการฝึกอบรมด้วยข้อมูลที่รวบรวมจากแหล่งข้อมูลทางภาษาที่หลากหลาย รวมถึงหนังสือพิมพ์ท้องถิ่น โซเชียลมีเดีย และวิทยุกระจายเสียงชุมชน ซึ่งจากการพัฒนาเทคโนโลยีดังกล่าวได้เข้าไปมีส่วนช่วยอำนวยความสะดวกในการสื่อสารแบบเรียลไทม์ระหว่างเจ้าหน้าที่บรรเทาทุกข์และชุมชนที่ได้รับผลกระทบทำให้ข้อมูลสำคัญเกี่ยวกับการปฏิบัติการบรรเทาทุกข์ได้รับการถ่ายทอดและเข้าใจอย่างถูกต้อง หรือกรณีศึกษาเกี่ยวกับการเพิ่มประสิทธิภาพการสนับสนุนลูกค้าทั่วโลกด้วย AI โดยการพัฒนา LLM ที่ครอบคลุมวัฒนธรรมในทุกภูมิภาค และมีการฝึก AI ให้รับรู้และปรับให้เข้ากับความแตกต่างทางวัฒนธรรมในรูปแบบการสื่อสารและความคาดหวังของลูกค้า ซึ่งผลที่เกิดขึ้นก็คือ AI สามารถจัดการกับคำถามที่มีความอ่อนไหวต่อบริบททางวัฒนธรรมได้มากขึ้น ก่อให้เกิดประโยชน์ทางการค้าและการบริการลูกค้า

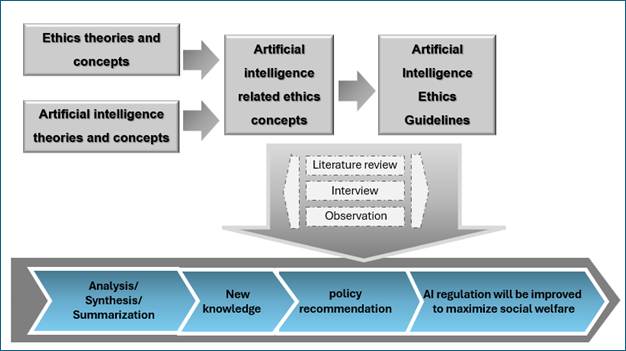

ทั้งนี้ จากการทบทวนแนวคิดและงานวิจัยที่กล่าวมาข้างต้น จึงนำมาสู่การกำหนดกรอบแนวคิดในการดำเนินโครงการ ซึ่งภายใต้โครงการนี้จะเปิดโอกาสให้มีการศึกษาวิจัยบนพื้นฐานของแนวคิดด้านจริยธรรมที่เกี่ยวข้องกับปัญญาประดิษฐ์ที่หลากหลายตั้งแต่อดีตจนปัจจุบัน ตลอดจนศึกษาแนวทางจริยธรรมปัญญาประดิษฐ์ที่ได้รับการพัฒนาขึ้นจากแนวคิดเหล่านั้น ในขณะเดียวกัน ในกระบวนการศึกษาวิจัยก็จะเน้นการทบทวนเอกสารทางวิชาการเช่นเดียวกันงานวิจัยส่วนใหญ่ที่กล่าวมาข้างต้น แต่จะเปิดกว้างให้นักวิจัยในโครงการสามารถเลือกใช้แนวคิดด้านจริยธรรมและมุมมองของตนเองในการศึกษาวิเคราะห์เพื่อให้ได้องค์ความรู้ใหม่ๆ ต่อไป

ภาพที่ 3 กรอบแนวคิดในการดำเนินโครงการ

4. ระเบียบวิธีวิจัย รายละเอียดของขั้นตอนการดําเนินงานจริงตามแผนงาน

การศึกษาวิจัยตลอด 3 ปี ประกอบด้วยกิจกรรม 2 ส่วนหลักๆ คือ การศึกษาวิจัยและพัฒนาบุคลากร และการนำงานวิจัยไปขยายผล ดังนี้

การศึกษาวิจัยและพัฒนาบุคลากร ประกอบด้วยขั้นตอนดังนี้

- การทบทวนวรรณกรรมที่เกี่ยวข้องเพื่อนำมากำหนดเป็นกรอบและแนวทางการศึกษาวิจัย ตลอดจนนำไปสู่การวิเคราะห์ สรุปผล และจัดทำในรูปของบทความวิจัยเพื่อตีพิมพ์ทั้งในวารสารนานาชาติและวารสารในประเทศ ซึ่งคาดว่าตลอดช่วง 3 ปีจะมีบทความที่ได้รับการตีพิมพ์ไม่ต่ำกว่า 8 บทความที่ได้รับการตีพิมพ์ในวารสารนานาชาติ และมีอีก 6 บทความที่ตีพิมพ์ในประเทศ นอกจากนี้ ยังตีพิมพ์ในรูปของหนังสืออีก 1 ฉบับ ซึ่งจะตีพิมพ์โดยสำนักพิมพ์ที่มีชื่อเสียงในระดับนานาชาติ

- จัดประชุมปฏิบัติการอย่างน้อย 3 ครั้งต่อปี เพื่อให้สมาชิกที่เข้ามาร่วมโครงการวิจัยได้นำเสนอผลการศึกษาและแลกเปลี่ยนความคิดเห็นระหว่างกัน อีกทั้งยังเชิญผู้เชี่ยวชาญในสาขาที่เกี่ยวข้องกับปัญญาประดิษฐ์เข้ามาร่วมให้ข้อคิดเห็น

ทั้งนี้ ในกระบวนการศึกษาวิจัยจะสร้างการมีส่วนร่วมระหว่างอาจารย์/นักศึกษาจากหลากหลายสาขาที่มีความเกี่ยวข้องกับปัญญาประดิษฐ์ เพื่อเข้ามาร่วมแลกเปลี่ยนเรียนรู้ แลกเปลี่ยนมุมมอง และลงมือศึกษาวิจัย เพื่อผลิตองค์ความรู้ที่เป็นการบูรณาการความรู้จากศาสตร์ต่างๆ ซึ่งตลอดกระบวนการวิจัยจะเป็นการฝึกอบรมพัฒนาศึกษาในการทำวิจัยไปพร้อมๆ กับการสร้างการมีส่วนร่วมเพื่อศึกษาออกแบบแนวจริยธรรมที่สอดรับกับมุมมองของคนจากหลากหลายสาขา โดยการดำเนินโครงการในแต่ละปีจะได้รับความร่วมมือจากอาจารย์ 6 คน และนักศึกษาอีก 10 คน ซึ่งจะเข้ามาร่วมตลอดกระบวนการ ตั้งแต่การศึกษาวิจัย การประชุมเชิงปฏิบัติการ และการประชุมสัมมนานานาชาติ ตลอดจนการจัดเสวนาในระหว่างกระบวนการทำวิจัยผ่านสื่อออนไลน์

การนำงานวิจัยไปขยายผล ประกอบด้วยขั้นตอนดังนี้

- จัดประชุมสัมมนาวิชาการนานาชาติ 1 ครั้งในปีสุดท้ายของโครงการวิจัย เพื่อเผยแพร่องค์ความรู้จากการศึกษาวิจัยของผู้ที่เข้าร่วมโครงการไปยังสาธารณชนในวงกว้าง เพื่อสร้างความเชื่อมโยงระหว่างการวิจัยกับการพัฒนานโยบายสาธารณะ ในขณะเดียวกันก็มีการเชิญผู้วางนโยบายภาครัฐเข้ามาร่วมรับฟังเพื่อนำองค์ความรู้ไปปรับใช้ในการออกแบบนโยบายที่เกี่ยวข้องกับจริยธรรมปัญญาประดิษฐ์ที่จะช่วยสร้างสังคมที่เสมอภาคและยั่งยืนมากขึ้น ซึ่งในการประชุมก็จะมีการถ่ายทอดสดผ่านสื่อต่างๆ เช่น Youtube โดยถ่ายทอดสู่สาธารณชนทั้งในและต่างประเทศ

- จัดทำสมุดปกขาวเพื่อเสนอแนะนโยบายที่เกี่ยวข้องกับจริยธรรมปัญญาประดิษฐ์ โดยนำองค์ความรู้จากการศึกษาวิจัย และผลการเสนอแนะข้อคิดเห็นจากการประชุมข้างต้น มาปรับใช้

นอกจากนี้ยังมีการเผยแพร่องค์ความรู้ผ่านสื่อออนไลน์ เช่น เว็บไซต์ของโครงการ ที่จะนำเสนอข้อมูลตลอดกระบวนการวิจัย ตั้งแต่ข้อมูลเกี่ยวกับโครงการ ผลการศึกษาวิจัยที่ดำเนินการโดยอาจารย์และนักศึกษาที่เข้ามาร่วมโครงการ นอกจากนี้ยังมีพื้นที่สำหรับการเข้าร่วมแลกเปลี่ยนข้อคิดเห็นและข้อเสนอแนะสำหรับผู้ที่เกี่ยวข้อง

ในขณะเดียวกันก็มีการเผยแพร่องค์ความรู้ผ่านสื่ออื่นๆ เช่น Facebook, Twitter, Instagram เพื่อให้สาธารณชนสามารถเข้ามาศึกษาและให้ข้อเสนอแนะเกี่ยวกับโครงการ